Φονικές εφαρμογές

Η τεχνητή νοημοσύνη θα ενισχύσει την οικονομική ανάπτυξη, θα βοηθήσει στην διάγνωση και θεραπεία ασθενειών, θα μειώσει τα τροχαία ατυχήματα και θα βελτιώσει την καθημερινή ζωή των ανθρώπων με χιλιάδες τρόπους. Όπως και κάθε νέα τεχνολογία, ωστόσο, η τεχνητή νοημοσύνη έχει επίσης μια σκοτεινότερη πλευρά.

Ο PAUL SCHARRE είναι ανώτερος συνεργάτης και διευθυντής του Προγράμματος Τεχνολογίας και Εθνικής Ασφάλειας στο Center for a New American Security. Είναι ο συγγραφέας του βιβλίου με τίτλο Army of None: Autonomous Weapons and the Future of War [1].

Το έθνος που θα ηγηθεί στην ανάπτυξη της τεχνητής νοημοσύνης, διακήρυξε ο Ρώσος πρόεδρος Βλαντιμίρ Πούτιν [2] το 2017 θα «γίνει ο ηγεμόνας του κόσμου». Αυτή η άποψη έχει γίνει συνηθισμένη στις πρωτεύουσες του κόσμου. Ήδη, περισσότερες από δώδεκα κυβερνήσεις έχουν ανακοινώσει εθνικές πρωτοβουλίες τεχνητής νοημοσύνης (Artificial Intelligence, AI). Το 2017, η Κίνα έθεσε ως στόχο να γίνει ο παγκόσμιος ηγέτης της AI μέχρι το 2030. Νωρίτερα φέτος, ο Λευκός Οίκος δημοσιοποίησε την Αμερικανική Πρωτοβουλία AI και το Υπουργείο Άμυνας των ΗΠΑ ανέπτυξε μια στρατηγική για την AI.

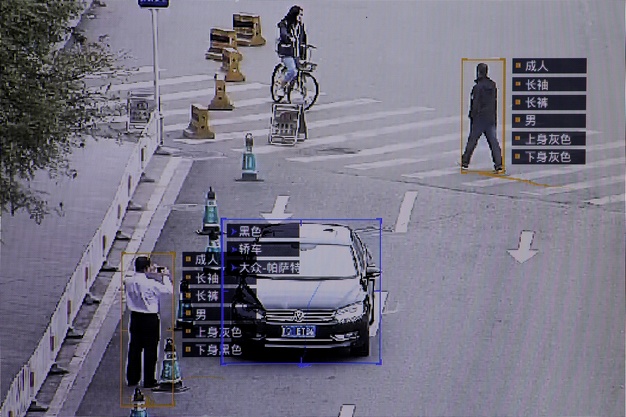

Βλέποντας όπως τα κράτη: Μια δοκιμή λογισμικού παρακολούθησης της SenseTime στο Πεκίνο, τον Οκτώβριο του 2017. Thomas Peter / REUTERS

----------------------------------------------------

Αλλά η αναδυόμενη αφήγηση περί μιας «κούρσας εξοπλισμών ΑΙ» αντικατοπτρίζει μια εσφαλμένη αντίληψη των κινδύνων από την ΑΙ -και ως εκ τούτου εισάγει σημαντικούς νέους κινδύνους. Για κάθε χώρα, ο πραγματικός κίνδυνος δεν είναι ότι θα μείνει πίσω από τους ανταγωνιστές της στην AI, αλλά ότι η αντίληψη μιας κούρσας θα ωθήσει τους πάντες να σπεύσουν να αναπτύξουν ανασφαλή συστήματα AI. Στην επιθυμία τους να κερδίσουν, οι χώρες κινδυνεύουν να βλάψουν τον εαυτό τους εξίσου με τους αντιπάλους τους.

Η AI υπόσχεται να φέρει και τεράστια οφέλη, από την υγειονομική περίθαλψη έως τις μεταφορές, και τεράστιους κινδύνους. Αλλά αυτοί οι κίνδυνοι δεν είναι κάτι που βγαίνει από την επιστημονική φαντασία˙ δεν υπάρχει λόγος να φοβόμαστε μια εξέγερση των ρομπότ. Η πραγματική απειλή θα προέλθει από τον άνθρωπο.

Αυτή την στιγμή, τα συστήματα AI είναι ισχυρά αλλά αναξιόπιστα. Πολλά από αυτά είναι ευάλωτα σε εξελιγμένες επιθέσεις ή αποτυγχάνουν όταν χρησιμοποιούνται εκτός του περιβάλλοντος στο οποίο εκπαιδεύτηκαν. Οι κυβερνήσεις θέλουν τα συστήματά τους να λειτουργούν σωστά, αλλά ο ανταγωνισμός ασκεί πιέσεις για την συντόμευση της [εξελικτικής] διαδρομής. Ακόμα κι αν άλλες χώρες δεν βρίσκονται στα πρόθυρα σημαντικών ανακαλύψεων της AI, η αντίληψη ότι ορμούν προς τα εμπρός θα μπορούσε να ωθήσει τους άλλους να κάνουν το ίδιο. Και αν μια κυβέρνηση ανέπτυσσε ένα μη δοκιμασμένο οπλικό σύστημα AI ή βασιζόταν σε ένα ελαττωματικό σύστημα AI για την εξαπόλυση κυβερνοεπιθέσεων, το αποτέλεσμα θα μπορούσε να είναι καταστροφικό για όλους τους εμπλεκόμενους.

Οι υπεύθυνοι χάραξης πολιτικής θα πρέπει να μάθουν από την ιστορία των δικτύων υπολογιστών και να κάνουν την ασφάλεια έναν από τους κορυφαίους παράγοντες στον σχεδιασμό της AI από την αρχή. Θα πρέπει επίσης να χαμηλώσουν την ρητορική σχετικά με μια κούρσα εξοπλισμών AI και να αναζητήσουν ευκαιρίες συνεργασίας με άλλες χώρες για να μειώσουν τους κινδύνους από την AI. Μια κούρσα στο χαμηλότερο επίπεδο ασφάλειας της AI, είναι μια κούρσα που κανείς δεν θα κερδίσει.

Η Α.Ι. ΤΟ ΕΧΕΙ

Το πιο απλό είδος συστήματος AI εκτελεί καθήκοντα ακολουθώντας μια σειρά κανόνων που έχουν καθοριστεί εκ των προτέρων από τον άνθρωπο. Αυτά τα «ειδικά συστήματα» (“expert systems”), όπως είναι γνωστά, υπάρχουν εδώ και δεκαετίες. Είναι πλέον τόσο πανταχού παρόντα που δύσκολα σταματάμε για να σκεφτούμε την τεχνολογία πίσω από τους αυτόματους πιλότους των αεροπλάνων ή το λογισμικό φορολογικής προετοιμασίας ως AI. Αλλά τα τελευταία χρόνια, η πρόοδος στην συλλογή δεδομένων, η υπολογιστική ισχύς των κομπιούτερ και ο σχεδιασμός των αλγορίθμων επέτρεψαν στους ερευνητές να κάνουν μεγάλη πρόοδο με μια πιο ευέλικτη μέθοδο AI: Την μηχανική μάθηση (machine learning).

Στη μηχανική μάθηση, ένας προγραμματιστής δεν γράφει τους κανόνες˙ το μηχάνημα τους διαλέγει με το να αναλύει τα δεδομένα που του δίδονται. Τροφοδοτήστε έναν αλγόριθμο με χιλιάδες χαρακτηρισμένες (labeled) φωτογραφίες αντικειμένων και θα μάθει να συσχετίζει τα μοτίβα στις εικόνες με τα ονόματα των αντικειμένων. Η τρέχουσα έκρηξη του ΑΙ άρχισε [3] το 2012, όταν οι ερευνητές πραγματοποίησαν μια ανακάλυψη χρησιμοποιώντας μια τεχνική εκμάθησης των μηχανών που ονομάζεται «βαθιά μάθηση» (“deep learning”), η οποία βασίζεται σε βαθιά νευρωνικά δίκτυα. Τα νευρωνικά δίκτυα είναι μια τεχνική ΑΙ που είναι χαλαρά εμπνευσμένη από τους βιολογικούς νευρώνες, τα κύτταρα που επικοινωνούν με άλλα κύτταρα με την αποστολή και λήψη ηλεκτρικών παλμών. Ένα τεχνητό νευρωνικό δίκτυο ξεκινά ως κενό μητρώο˙ δεν ξέρει τίποτα. Το σύστημα μαθαίνει με το να προσαρμόζει την ισχύ των συνδέσεων μεταξύ των νευρώνων, ενισχύοντας ορισμένες οδούς για τις σωστές απαντήσεις και εξασθενίζοντας τις συνδέσεις για τις λάθος απαντήσεις. Ένα βαθύ νευρωνικό δίκτυο -ο τύπος που είναι υπεύθυνος για την βαθιά μάθηση- είναι ένα νευρωνικό δίκτυο με πολλά στρώματα τεχνητών νευρώνων ανάμεσα στα στρώματα εισόδου και εξόδου. Τα επιπλέον στρώματα επιτρέπουν μεγαλύτερη μεταβλητότητα στις δυνάμεις των διαφόρων οδών και έτσι βοηθούν την ΑΙ να αντιμετωπίσει μια ευρύτερη ποικιλία περιστάσεων.

Το πώς ακριβώς μαθαίνει το σύστημα εξαρτάται από τον αλγόριθμο μηχανικής μάθησης και το είδος των δεδομένων που χρησιμοποιούν οι προγραμματιστές. Πολλές προσεγγίσεις χρησιμοποιούν δεδομένα που έχουν ήδη χαρακτηριστεί (γνωστές ως «μάθηση υπό επίβλεψη», “supervised learning”), αλλά οι μηχανές μπορούν επίσης να μάθουν από δεδομένα που δεν φέρουν χαρακτηρισμό (label) («μάθηση χωρίς επίβλεψη», “unsupervised learning”) ή απευθείας από το περιβάλλον («ενισχυμένη μάθηση», “reinforcement learning”). Οι μηχανές μπορούν επίσης να εκπαιδεύονται με συνθετικά δεδομένα που παράγονται από υπολογιστή. Η εταιρεία αυτόνομων αυτοκινήτων Waymo οδήγησε [4] τα αυτοκίνητά της για πάνω από δέκα εκατομμύρια μίλια σε δημόσιους δρόμους, αλλά η εταιρεία πραγματοποιεί δέκα εκατομμύρια μίλια σε προσομοιώσεις υπολογιστών κάθε μέρα, κάτι που της επιτρέπει να δοκιμάσει τους αλγορίθμους της σε δισεκατομμύρια μίλια συνθετικών δεδομένων.

Από την ανακάλυψη της βαθιάς εκμάθησης το 2012, οι ερευνητές δημιούργησαν συστήματα AI που μπορούν να φτάσουν ή να ξεπεράσουν τις καλύτερες επιδόσεις του ανθρώπου στο να αναγνωρίζουν πρόσωπα, να εντοπίζουν αντικείμενα, να μεταγράφουν ομιλίες και να παίζουν σύνθετα παιχνίδια, συμπεριλαμβανομένου του κινεζικού επιτραπέζιου παιχνιδιού γκο [5] και του παιχνιδιού υπολογιστών σε πραγματικό χρόνο StarCraft. Η βαθιά εκμάθηση άρχισε επίσης να ξεπερνά τα παλαιότερα συστήματα ΑΙ που βασίζονται σε κανόνες. Το 2018, ένας αλγόριθμος βαθιάς μάθησης νίκησε [6] το βασικό πρόγραμμα υπολογιστή για σκάκι αφού πέρασε μόλις τέσσερις ώρες παίζοντας εκατομμύρια παιχνίδια ενάντια στον εαυτό του σε έναν τεράστιο υπερυπολογιστή χωρίς κανένα ανθρώπινο δεδομένο εκπαίδευσης ή κανόνες γραμμένους με το χέρι για να καθοδηγήσουν την συμπεριφορά του.

Οι ερευνητές εφαρμόζουν τώρα την AI σε πλήθος προβλημάτων του πραγματικού κόσμου, από την διάγνωση καρκίνων του δέρματος έως την οδήγηση αυτοκινήτων και μέχρι την βελτιστοποίηση της ενεργειακής απόδοσης. Σύμφωνα με μια εκτίμηση [7] της συμβουλευτικής εταιρείας McKinsey, σχεδόν το ήμισυ του συνόλου των καθηκόντων που πληρώνονται άνθρωποι για να τα εκτελέσουν στις Ηνωμένες Πολιτείες θα μπορούσε να αυτοματοποιηθεί με την υπάρχουσα τεχνολογία (αν και θα μπορούσε να εξαλειφθεί εξ ολοκλήρου λιγότερο από το 5% των θέσεων εργασίας). Τα εργαλεία AI γίνονται επίσης ευρύτερα διαθέσιμα. Μεγάλοι οργανισμοί είναι πιο πιθανό να κάνουν σημαντικές ανακαλύψεις, χάρη στην ικανότητά τους να συγκεντρώνουν μεγάλα σύνολα δεδομένων και τεράστιες ποσότητες υπολογιστικής ισχύος [8]. Αλλά πολλά από τα εργαλεία AI που προκύπτουν είναι διαθέσιμα στο διαδίκτυο για να τα χρησιμοποιήσει οποιοσδήποτε. Τα δωρεάν μαθήματα προγραμματισμού διδάσκουν στους ανθρώπους πώς να κάνουν τα δικά τους συστήματα AI και τα εκπαιδευμένα νευρωνικά δίκτυα είναι δωρεάν για να μεταφορτωθούν (download). Η προσβασιμότητα θα ωθήσει την καινοτομία, αλλά η τοποθέτηση ισχυρών εργαλείων AI στα χέρια οποιουδήποτε τα θέλει, θα βοηθήσει και αυτούς που θέλουν να κάνουν ζημιά.

ΠΛΗΡΟΦΟΡΙΕΣ ΑΥΤΑΡΧΙΚΩΝ

Η ζημιά από την κακή χρήση της AI δεν είναι υποθετική˙ είναι ήδη εδώ. Τα bots χρησιμοποιούνται τακτικά για να χειραγωγούν τα κοινωνικά μέσα, ενισχύοντας κάποια μηνύματα και καταπνίγοντας άλλα. Τα deepfakes, τα ψευδή βίντεο που έχουν δημιουργηθεί με AI, έχουν χρησιμοποιηθεί σε λεγόμενες εκδικητικές πορνογραφικές επιθέσεις, στις οποίες το πρόσωπο ενός ατόμου είναι ψηφιακά προσαρμοσμένο στο σώμα ενός πορνογραφικού ηθοποιού.

Αυτά τα παραδείγματα είναι μόνο η αρχή. Οι πολιτικές εκστρατείες θα χρησιμοποιούν αναλύσεις δεδομένων που βασίζονται σε AI για να στοχεύουν άτομα με πολιτική προπαγάνδα ειδικά προσαρμοσμένη για αυτούς. Οι εταιρείες θα χρησιμοποιούν τις ίδιες αναλύσεις για τον σχεδιασμό διαφήμισης χειραγώγησης. Οι ψηφιακοί κλέφτες θα χρησιμοποιούν τα εργαλεία AI για να δημιουργήσουν αποτελεσματικότερες επιθέσεις phishing. Τα bots θα είναι σε θέση να μιμηθούν πειστικά ανθρώπους σε απευθείας σύνδεση και μέσω τηλεφώνου κλωνοποιώντας την φωνή ενός ατόμου με μόλις ένα λεπτό ήχου [στην διάθεσή τους]. Οποιαδήποτε αλληλεπίδραση που δεν θα γίνεται αυτοπροσώπως θα είναι ύποπτη. Οι ειδικοί ασφαλείας έχουν δείξει ότι είναι δυνατή η διείσδυση (hack) σε αυτόνομα αυτοκίνητα, απενεργοποιώντας το σύστημα διεύθυνσης και τα φρένα. Ένα άτομο και μόνο θα μπορούσε να κατασχέσει παράνομα ολόκληρο στόλο οχημάτων με μερικές πληκτρολογήσεις, να δημιουργήσει μια κυκλοφοριακή συμφόρηση ή να ξεκινήσει μια τρομοκρατική επίθεση.

Η δύναμη της ΑΙ ως εργαλείου καταπίεσης είναι ακόμα πιο τρομακτική. Οι αυταρχικές κυβερνήσεις θα μπορούσαν να χρησιμοποιήσουν τα deepfakes για να δυσφημήσουν αντιφρονούντες, την αναγνώριση προσώπου για να επιτρέψουν τη μαζική επιτήρηση καθ’ όλο το εικοσιτετράωρο, και τις προγνωστικές αναλύσεις για τον εντοπισμό πιθανών ταραξιών. Η Κίνα έχει ήδη ξεκινήσει να βαδίζει στον δρόμο προς τον ψηφιακό αυταρχισμό. Έχει εκκινήσει μια μαζική εκστρατεία καταστολής [9] κατά του πληθυσμού των Μουσουλμάνων Ουιγούρων στην επαρχία Xinjiang. Πολλά από τα εργαλεία που χρησιμοποιεί η κυβέρνηση είναι χαμηλής τεχνολογίας, αλλά έχει επίσης αρχίσει να χρησιμοποιεί στοιχεία ανάλυσης δεδομένων (data analytics), συστήματα αναγνώρισης προσώπου, και προληπτική αστυνόμευση [10] (χρήση δεδομένων για την πρόβλεψη εγκληματικής δραστηριότητας). Τεράστια δίκτυα από κάμερες παρακολούθησης συνδέονται [11] με αλγόριθμους που μπορούν να ανιχνεύσουν [12] ανώμαλη συμπεριφορά πολιτών, από αντικανονικά σταθμευμένα οχήματα έως άτομα που τρέχουν εκεί όπου δεν επιτρέπεται. Η κινεζική εταιρεία Yuntian Lifei Technology υπερηφανεύεται [13] ότι το έξυπνο σύστημά της για βίντεοπαρακολούθηση έχει αναπτυχθεί σε σχεδόν 80 κινέζικες πόλεις και έχει εντοπίσει περίπου 6.000 περιστατικά που σχετίζονται με την «κοινωνική διακυβέρνηση». Ορισμένοι από τους τρόπους με τους οποίους οι κινεζικές Αρχές χρησιμοποιούν τώρα την AI φαίνονται ασήμαντοι, όπως η παρακολούθηση του πόσο χαρτί υγείας χρησιμοποιούν οι άνθρωποι στις δημόσιες τουαλέτες. Οι προτεινόμενες μελλοντικές χρήσεις της είναι πιο επιθετικές, όπως η παρακολούθηση των τρόπων χρήσης της ηλεκτρικής ενέργειας για σημάδια ύποπτης δραστηριότητας.

Η Κίνα δεν οικοδομεί μόνο ένα κράτος τεχνο-δυστοπικής επιτήρησης εγχωρίως˙ άρχισε επίσης να εξάγει την τεχνολογία της. Το 2018, η Ζιμπάμπουε υπέγραψε συμφωνία με την κινεζική εταιρεία CloudWalk Technology για την δημιουργία εθνικής βάσης δεδομένων προσώπων και την εγκατάσταση συστημάτων επιτήρησης αναγνώρισης προσώπου σε αεροδρόμια, σιδηροδρομικούς σταθμούς και στάσεις λεωφορείων. Υπάρχουν πολλά περισσότερα που διακυβεύονται στην συμφωνία πέρα από τα χρήματα. Η Ζιμπάμπουε συμφώνησε να αφήσει το CloudWalk να στέλνει δεδομένα από εκατομμύρια πρόσωπα πίσω στην Κίνα, βοηθώντας την εταιρεία να βελτιώσει τα συστήματα αναγνώρισης προσώπου για άτομα με σκούρο δέρμα. Η Κίνα σχεδιάζει επίσης να πουλήσει τεχνολογία επιτήρησης στη Μαλαισία, τη Μογγολία και την Σιγκαπούρη.

Η Κίνα εξάγει τους αυταρχικούς νόμους και τις πολιτικές της, επίσης. Σύμφωνα με το Freedom House, η Κίνα πραγματοποίησε εκπαιδευτικές συναντήσεις με κυβερνητικούς αξιωματούχους και μέλη των μέσων ενημέρωσης από περισσότερες από 30 χώρες σχετικά με τις μεθόδους παρακολούθησης και ελέγχου της κοινής γνώμης. Τρεις χώρες -η Τανζανία, η Ουγκάντα και το Βιετνάμ- πέρασαν περιοριστικούς νόμους για τα μέσα μαζικής ενημέρωσης και την ασφάλεια στον κυβερνοχώρο αμέσως μετά την συνεργασία τους με την Κίνα.

Αστυνομικός έξω από ένα «κέντρο εκπαίδευσης επαγγελματικών δεξιοτήτων» στην Αυτόνομη Περιφέρεια Σινγιάνγκ των Ουιγούρων, τον Σεπτέμβριο του 2018. THOMAS PETER / REUTERS

----------------------------------------------------

ΤΙ ΘΑ ΚΑΝΕΙ Η Α.Ι.

Όποια χώρα κι αν αναλάβει την ηγεσία στην AI θα την χρησιμοποιήσει για να κερδίσει οικονομικά και στρατιωτικά πλεονεκτήματα έναντι των ανταγωνιστών της. Μέχρι το 2030, η ΑΙ προβλέπεται να προσθέσει μεταξύ 13 και 15 τρισεκατομμύρια δολάρια στην παγκόσμια οικονομία. Η AI θα μπορούσε επίσης να επιταχύνει τον ρυθμό των επιστημονικών ανακαλύψεων. Το 2019, ένα τεχνητό νευρωνικό δίκτυο υπερέβαινε σημαντικά τις υπάρχουσες προσεγγίσεις στην ανάμιξη συνθετικών πρωτεϊνών, ένα βασικό έργο στην βιολογική έρευνα.

Η AI αναμένεται επίσης να φέρει επανάσταση στις εχθροπραξίες. Θα αποδειχθεί πολύ χρήσιμη για την βελτίωση της επίγνωσης της κατάστασης (situational awareness) που έχουν οι στρατιώτες στο πεδίο της μάχης και την ικανότητα των διοικητών να λαμβάνουν αποφάσεις και να επικοινωνούν εντολές. Τα συστήματα AI μπορούν να επεξεργάζονται περισσότερες πληροφορίες από όσες οι άνθρωποι και μπορούν να το κάνουν πιο γρήγορα, καθιστώντας τις πολύτιμα εργαλεία για την αξιολόγηση των χαοτικών μαχών σε πραγματικό χρόνο. Στο ίδιο το πεδίο της μάχης, οι μηχανές μπορούν να κινούνται ταχύτερα και με μεγαλύτερη ακρίβεια και συντονισμό από όσο οι άνθρωποι. Στον πρόσφατο αγώνα της StarCraft «AI εναντίον ανθρώπου», το σύστημα AI, AlphaStar, επέδειξε υπεράνθρωπες ικανότητες στην ταχεία επεξεργασία μεγάλων ποσοτήτων πληροφοριών, τον συντονισμό των μονάδων του, και την γρήγορη και ακριβή μετακίνησή τους. Στον πραγματικό κόσμο, αυτά τα πλεονεκτήματα θα επιτρέψουν στα συστήματα AI να διαχειριστούν σμήνη ρομπότ πολύ πιο αποτελεσματικά από όσο θα μπορούσαν οι άνθρωποι ελέγχοντάς τα χειροκίνητα. Οι άνθρωποι θα διατηρήσουν τα πλεονεκτήματά τους στην υψηλότερου επιπέδου στρατηγική, αλλά η ΑΙ θα κυριαρχεί επί του πεδίου.

Η βιασύνη της Ουάσινγκτον για την ανάπτυξη της AI καθοδηγείται από τον φόβο ότι θα μείνει πίσω από την Κίνα, η οποία είναι ήδη μια παγκόσμια ατμομηχανή στην ΑΙ. Οι κινεζικοί τεχνολογικοί γίγαντες Alibaba, Baidu και Tencent κατατάσσονται δίπλα στην Amazon, την Google και τη Microsoft ως κορυφαίες εταιρίες AI. Πέντε από τις δέκα καινοφανείς επιχειρήσεις AI [14] με την μεγαλύτερη χρηματοδότηση πέρυσι ήταν κινεζικές. Πριν από δέκα χρόνια, ο στόχος της Κίνας να γίνει παγκόσμια ηγέτις της AI μέχρι το 2030 θα φαινόταν φανταστικός˙ σήμερα, είναι μια πραγματική δυνατότητα.

Εξίσου ανησυχητικός για τους υπεύθυνους χάραξης πολιτικής των ΗΠΑ είναι ο οξύς διχασμός μεταξύ της Ουάσινγκτον και της Silicon Valley για την στρατιωτική χρήση της AI. Οι εργαζόμενοι της Google και της Microsoft έχουν αντιταχθεί στα συμβόλαια των εταιρειών τους με το Πεντάγωνο, με αποτέλεσμα η Google να διακόψει την δουλειά σε ένα έργο που χρησιμοποιεί την AI για να αναλύει καταγραφές βίντεο. Το αυταρχικό καθεστώς της Κίνας δεν επιτρέπει αυτό το είδος ανοικτής διαφωνίας. Το μοντέλο της «στρατιωτικο-πολιτικής σύντηξης» σημαίνει ότι οι κινεζικές τεχνολογικές καινοτομίες θα μεταφραστούν ευκολότερα σε στρατιωτικά οφέλη. Ακόμη και αν οι Ηνωμένες Πολιτείες διατηρήσουν το προβάδισμα στην ΑΙ, θα μπορούσαν να χάσουν το στρατιωτικό τους πλεονέκτημα. Η λογική απάντηση στην απειλή από μια άλλη χώρα που κερδίζει τον αγώνα της AI είναι να διπλασιάσει τις επενδύσεις της σε AI. Το πρόβλημα είναι ότι η τεχνολογία AI δημιουργεί κινδύνους όχι μόνο σε αυτούς που χάνουν την κούρσα αλλά και σε εκείνους που την κερδίζουν.

Η ΜΟΝΗ ΝΙΚΗΦΟΡΑ ΚΙΝΗΣΗ ΚΑΠΟΙΟΥ ΕΙΝΑΙ ΝΑ ΜΗΝ ΠΑΙΞΕΙ

Οι σημερινές τεχνολογίες AI είναι ισχυρές αλλά αναξιόπιστες. Τα βασιζόμενα σε κανόνες συστήματα δεν μπορούν να αντιμετωπίσουν τις περιστάσεις που δεν προβλέφθηκαν από τους προγραμματιστές τους. Τα συστήματα μάθησης περιορίζονται από τα δεδομένα (data) επί των οποίων έχουν εκπαιδευτεί. Οι αποτυχίες της AI έχουν ήδη οδηγήσει σε τραγωδίες. Προηγμένες λειτουργίες αυτόματου πιλότου στα αυτοκίνητα, αν και έχουν καλή απόδοση σε ορισμένες περιπτώσεις, οδήγησαν κάποια αυτοκίνητα χωρίς προειδοποίηση πάνω σε φορτηγά, σε φράγματα από μπετόν, και σε σταθμευμένα αυτοκίνητα. Σε μια λανθασμένη κατάσταση, τα συστήματα AI πηγαίνουν από το «υπερέξυπνο» στο «υπερανόητο» σε μια στιγμή. Όταν ένας εχθρός προσπαθεί να χειραγωγήσει και να διεισδύσει σε ένα σύστημα ΑΙ, οι κίνδυνοι είναι ακόμα μεγαλύτεροι.

Ακόμα και όταν δεν καταρρέουν εντελώς, τα συστήματα μάθησης μερικές φορές μαθαίνουν να επιτυγχάνουν τους στόχους τους με λάθος τρόπο. Σε μια ερευνητική εργασία [15] πέρυσι, μια ομάδα 52 ερευνητών της AI εξιστόρησαν δεκάδες φορές που τα συστήματα AI έδειξαν απρόσμενη συμπεριφορά. Ένας αλγόριθμος που μαθαίνει να περπατάει σε ένα προσομοιωμένο περιβάλλον ανακάλυψε ότι θα μπορούσε να κινηθεί ταχύτερα με το να πέφτει επανειλημμένα. Ένα bot που παίζει Tetris έμαθε να σταματά το παιχνίδι πριν πέσει το τελευταίο τούβλο, ώστε να μην χάνει ποτέ. Ένα πρόγραμμα διέγραψε τα αρχεία που περιείχαν τις απαντήσεις επί των οποίων θα αξιολογείτο, προκαλώντας έτσι την επίτευξη ενός τέλειου αποτελέσματος. Όπως έγραψαν οι ερευνητές, «Είναι συχνά λειτουργικά απλούστερο για την εξέλιξη να εκμεταλλεύεται τα κενά στην ποσοτική μέτρηση από όσο είναι το να επιτυγχάνει το πραγματικά επιθυμητό αποτέλεσμα». Η έκπληξη φαίνεται να αποτελεί τυπικό χαρακτηριστικό των συστημάτων μάθησης.

Τα συστήματα μάθησης των μηχανών είναι πάντα τόσο καλά όσο τα δεδομένα της εκπαίδευσής τους. Αν τα δεδομένα (data) δεν αντιπροσωπεύουν καλά το λειτουργικό περιβάλλον του συστήματος, το σύστημα μπορεί να αποτύχει στον πραγματικό κόσμο. Το 2018, για παράδειγμα, οι ερευνητές στο MIT Media Lab έδειξαν ότι τρία κορυφαία συστήματα αναγνώρισης προσώπου ήταν πολύ χειρότερα κατά την ταξινόμηση των σκουρόχρωμων προσώπων από όσο ήταν στην ταξινόμηση των ανοιχτόχρωμων προσώπων.

Όταν αποτυγχάνουν, τα συστήματα μηχανικής μάθησης είναι συχνά απογοητευτικά ομιχλώδη. Στα βασισμένα σε κανόνες συστήματα, οι ερευνητές μπορούν πάντα να εξηγήσουν την συμπεριφορά του μηχανισμού, ακόμα και αν δεν μπορούν πάντα να την προβλέψουν. Στα συστήματα βαθιάς μάθησης, ωστόσο, οι ερευνητές συχνά αδυνατούν να καταλάβουν γιατί μια μηχανή έκανε ό, τι έκανε. Ο Ali Rahimi, ένας ερευνητής της AI στην Google, υποστήριξε [16] ότι πάνω-κάτω όπως οι μεσαιωνικοί αλχημιστές, οι οποίοι ανακάλυψαν τις σύγχρονες τεχνικές της υαλουργίας αλλά δεν καταλάβαιναν την χημεία ή την φυσική πίσω από τις ανακαλύψεις τους, οι σύγχρονοι μηχανικοί της μηχανικής μάθησης μπορούν να επιτύχουν ισχυρά αποτελέσματα, αλλά τους λείπει η υποκείμενη επιστήμη για να τα εξηγήσουν.

Κάθε αποτυχία ενός συστήματος AI παρουσιάζει επίσης μια ευπάθεια που μπορεί να αξιοποιηθεί. Σε ορισμένες περιπτώσεις, οι επιτιθέμενοι μπορούν να δηλητηριάσουν τα δεδομένα της εκπαίδευσης. Το 2016, η Microsoft δημιούργησε ένα chatbot που το ονόμασε Tay και του έδωσε έναν λογαριασμό Twitter. Άλλοι χρήστες άρχισαν να αναρτούν προσβλητικά μηνύματα σε αυτόν, και μέσα σε 24 ώρες, ο Tay είχε αρχίσει να παπαγαλίζει την ρατσιστική και αντισημιτική γλώσσα. Στην περίπτωση αυτή, η πηγή των κακών data ήταν προφανής. Αλλά δεν είναι όλες οι επιθέσεις δηλητηρίασης δεδομένων τόσο ορατές. Κάποιες μπορούν να θαφτούν μέσα στα δεδομένα εκπαίδευσης (training data) με τρόπο που δεν μπορεί να ανιχνευθεί από τον άνθρωπο αλλά εξακολουθούν να χειραγωγούν το μηχάνημα.

Ακόμη και αν οι δημιουργοί ενός συστήματος βαθιάς εκμάθησης (deep-learning system) προστατεύουν τις πηγές των δεδομένων του, το σύστημα μπορεί ακόμα να εξαπατηθεί χρησιμοποιώντας αυτά που είναι γνωστά ως «αντιφατικά παραδείγματα» (“adversarial examples”), όπου ένας επιτιθέμενος τροφοδοτεί το σύστημα με μια εισροή που είναι προσεκτικά προσαρμοσμένη για να κάνει το μηχάνημα να προβεί σε ένα λάθος. Ένα νευρωνικό δίκτυο που ταξινομεί δορυφορικές εικόνες μπορεί να εξαπατηθεί στο να εκλάβει μια ελαφρώς αλλοιωμένη εικόνα ενός νοσοκομείου ως στρατιωτικό αεροδρόμιο ή αντίστροφα. Η αλλαγή στην εικόνα μπορεί να είναι τόσο μικρή ώστε η εικόνα να φαίνεται φυσιολογική σε έναν άνθρωπο [17], αλλά εξακολουθεί να εξαπατά την ΑΙ. Τα αντιφατικά παραδείγματα μπορούν μέχρι να τοποθετηθούν σε φυσικά αντικείμενα. Σε μια περίπτωση, οι ερευνητές δημιούργησαν μια πλαστική χελώνα με λεπτές σπείρες ενσωματωμένες στο κέλυφός της που έκανε ένα σύστημα ταυτοποίησης αντικειμένων να θεωρεί ότι επρόκειτο για τουφέκι. Σε ένα άλλο [18], οι ερευνητές τοποθέτησαν μια χούφτα μικρών λευκών και μαύρων τετραγώνων σε μια πινακίδα stop, προκαλώντας ένα νευρωνικό δίκτυο να την ταξινομήσει ως πινακίδα ταχύτητας 45 μιλίων ανά ώρα. Για να χειροτερέψουν τα πράγματα, οι επιτιθέμενοι μπορούν να αναπτύξουν αυτά τα είδη παραπλανητικών εικόνων και αντικειμένων χωρίς πρόσβαση στα δεδομένα εκπαίδευσης ή στον υποκείμενο αλγόριθμο του συστήματος που προσπαθούν να νικήσουν, και οι ερευνητές έχουν αγωνιστεί για να βρουν αποτελεσματικές άμυνες κατά της απειλής. Σε αντίθεση με τα τρωτά σημεία της κυβερνοασφάλειας, τα οποία συχνά μπορούν να διορθωθούν όταν αποκαλυφθούν, δεν υπάρχει γνωστός τρόπος πλήρους ανοσοποίησης των αλγορίθμων κατά των επιθέσεων αυτών.

Οι κυβερνήσεις έχουν ήδη μεγάλη εμπειρία δοκιμής σε στρατιωτικά, κυβερνο-επιχειρησιακά και επιτηρητικά εργαλεία, αλλά καμία μέθοδος δοκιμής δεν μπορεί να εγγυηθεί ότι τα πολύπλοκα συστήματα δεν θα βιώσουν δυσλειτουργίες όταν βγουν έξω στον πραγματικό κόσμο. Την πρώτη φορά που τα μαχητικά αεροσκάφη F-22 διέσχισαν την Διεθνή Γραμμή Ημερομηνίας (International Date Line, IDL), οι υπολογιστές τους κατέρρευσαν και τα αεροσκάφη είχαν σχεδόν απομονωθεί πάνω από τον Ειρηνικό Ωκεανό.

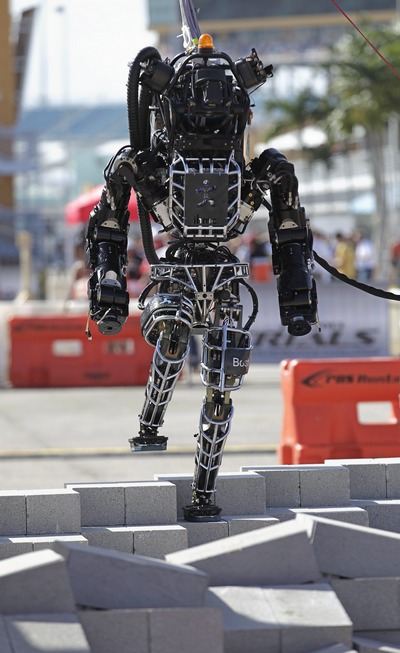

Το Atlas της Boston Dynamics, ένα ανθρωποειδές ρομπότ, κατά την διάρκεια άσκησης στο Homestead της Φλόριντα, τον Δεκέμβριο του 2013. Andrew Innerarity / REUTERS

----------------------------------------------------

Η δοκιμή συστημάτων AI απαιτεί συχνά περισσότερο χρόνο και χρήματα από την δοκιμή του παραδοσιακού στρατιωτικού εξοπλισμού. Η πολυπλοκότητά τους, η οποία τα καθιστά πιο ικανά, δημιουργεί επίσης περισσότερες ευκαιρίες για απροσδόκητες δυσλειτουργίες. Φανταστείτε ότι μια κυβέρνηση αναπτύσσει ένα σύστημα AI που μπορεί να εισβάλλει στα δίκτυα ηλεκτρονικών υπολογιστών των αντιπάλων της, αποφεύγοντας την ανίχνευση. Η πρώτη κυβέρνηση που θα αναπτύξει ένα τέτοιο σύστημα θα αποκτήσει τεράστιο πλεονέκτημα έναντι των ανταγωνιστών της. Ανησυχώντας ότι ένας αντίπαλος αναπτύσσει ένα παρόμοιο εργαλείο, η κυβέρνηση μπορεί να αισθάνεται υποχρεωμένη να μειώσει τις δοκιμές και να αναπτύξει το σύστημα από νωρίς. Αυτή η δυναμική έχει ήδη εκτυλιχθεί σε άλλες βιομηχανίες, όπως τα αυτο-οδηγούμενα αυτοκίνητα. Οι συνέπειες των ατυχημάτων που θα προκληθούν από τα εργαλεία AI της εθνικής ασφάλειας θα μπορούσαν να είναι πολύ χειρότερες.

Η AI δεν θα είναι η πρώτη περίπτωση όπου κυβερνήσεις βασίζονται σε ισχυρή αλλά ανασφαλή τεχνολογία. Αυτό ακριβώς συνέβη με τους υπολογιστές, οι οποίοι διαδραματίζουν κρίσιμο ρόλο σε όλα, από την διαπραγμάτευση μετοχών μέχρι το να κατευθύνουν πυραύλους, παρόλο που υποφέρουν από τεράστιες ευπάθειες. Το 2018, οι ερευνητές στο Γραφείο Λογοδοσίας της Κυβέρνησης των ΗΠΑ (U.S. Government Accountability Office, GAO) διαπίστωσαν ότι τα αμερικανικά οπλικά συστήματα ήταν γεμάτα με κενά κυβερνοασφάλειας που θα μπορούσαν να αξιοποιηθούν με «σχετικά απλά εργαλεία και τεχνικές». Ακόμη χειρότερα, οι υπεύθυνοι προγραμμάτων του Υπουργείου Άμυνας δεν γνώριζαν τα προβλήματα και απέρριψαν τα ευρήματα του GAO, υποστηρίζοντας ότι οι δοκιμές δεν ήταν ρεαλιστικές. Τα τρωτά σημεία ασφαλείας υπολογιστών δεν περιορίζονται στα κυβερνητικά συστήματα. Η μια εταιρεία μετά την άλλη υπέστησαν σημαντικές παραβιάσεις δεδομένων. Η ψηφιακή ασφάλεια είναι ήδη πάρα πολύ συχνά μια δεύτερη σκέψη. Ένας κόσμος ευρέως διαδεδομένων, μη προστατευμένων συστημάτων AI δεν είναι απλώς μια πιθανότητα˙ είναι το εξ’ ορισμού σκηνικό.

ΠΡΩΤΑ Η ΑΣΦΑΛΕΙΑ

Οι επείγουσες απειλές απαιτούν επείγουσες απαντήσεις. Ένας από τους σημαντικότερους τρόπους με τους οποίους οι αρμόδιοι για την χάραξη πολιτικής μπορούν να αντιμετωπίσουν τους κινδύνους που ενέχει η AI είναι να ενισχύσουν την χρηματοδότηση της έρευνας για την ασφάλεια της AI. Οι εταιρείες δαπανούν δισεκατομμύρια δολάρια για την εξεύρεση εμπορικών εφαρμογών για την ΑΙ, αλλά η κυβέρνηση των ΗΠΑ μπορεί να διαδραματίσει πολύτιμο ρόλο στην χρηματοδότηση της βασικής έρευνας για την ΑΙ, όπως έχει κάνει από τις πρώτες μέρες του τομέα. Η πρωτοβουλία AI Next, ένα πρόγραμμα που εκτελείται από την Υπηρεσία Προηγμένων Αμυντικών Ερευνητικών Προγραμμάτων (Defense Advanced Research Projects Agency) που πρόκειται να δαπανήσει 2 δισεκατομμύρια δολάρια για τα επόμενα πέντε χρόνια, έχει ως στόχο την αντιμετώπιση πολλών από τους περιορισμούς των στενά AI συστημάτων. Επεκτείνοντας την προσπάθεια αυτή, ο Λευκός Οίκος θα πρέπει να αυξήσει την χρηματοδότηση για την έρευνα για την ασφάλεια της ΑΙ στο πλαίσιο της νέας της American AI Initiative και θα πρέπει να ζητήσει από το Κογκρέσο πρόσθετα χρήματα για Ε&Α και για έρευνα στην ασφάλεια.

Όσον αφορά την εφαρμογή της ΑΙ στην εθνική ασφάλεια, οι κυβερνητικές υπηρεσίες θα πρέπει να επανεξετάσουν τις παραδοσιακές τους προσεγγίσεις για την δοκιμή νέων συστημάτων. Η επαλήθευση ότι ένα σύστημα πληροί τις προδιαγραφές του σχεδιασμού του δεν αρκεί. Οι δοκιμαστές πρέπει επίσης να διασφαλίσουν ότι θα συνεχίσει να λειτουργεί σωστά στον πραγματικό κόσμο όταν ένας αντίπαλος προσπαθεί να το νικήσει. Σε ορισμένες περιπτώσεις, μπορούν να χρησιμοποιήσουν προσομοιώσεις ηλεκτρονικών υπολογιστών για να ξεριζώσουν σφάλματα (bugs), όπως κάνουν τώρα οι κατασκευαστές για τα αυτόνομα αυτοκίνητα. Επιπλέον, τα Υπουργεία Άμυνας και Εσωτερικής Ασφάλειας και η κοινότητα πληροφοριών θα πρέπει να δημιουργήσουν «κόκκινες ομάδες» -ομάδες που θα ενεργούν ως επιτιθέμενοι για να δοκιμάσουν τις άμυνες ενός συστήματος- για να ανακαλύψουν τα τρωτά σημεία των συστημάτων AI, έτσι ώστε οι προγραμματιστές να μπορούν να τα διορθώσουν πριν ενεργοποιηθούν τα συστήματα αυτά.

Οι κυβερνητικοί αξιωματούχοι θα πρέπει επίσης να μετριάσουν την ρητορική τους για μια κούρσα εξοπλισμών στην ΑΙ, δεδομένου ότι μια τέτοια ρητορική θα μπορούσε εύκολα να γίνει αυτοεκπληρούμενη. Σε μια διάσκεψη το 2018, ο Michael Griffin, ο επικεφαλής αξιωματούχος του Πενταγώνου για την έρευνα και την μηχανοποίηση, δήλωσε: «Μπορεί να υπάρξει κούρσα εξοπλισμών στην τεχνητή νοημοσύνη, αλλά δεν είμαστε ακόμα σε αυτό». Οι στρατιώτες σίγουρα θα υιοθετήσουν την AI, αλλά από την δήλωση του Griffin έλλειπε κάθε ανησυχία -ή ακόμα και επίγνωση- για τους κινδύνους που συνδέονται με αυτήν. Η συζήτηση για την κούρσα εξοπλισμών ενθαρρύνει τους αντιπάλους να κάνουν συντομότερες τις διαδικασίες που στοχεύουν στην ασφάλεια. Οι κυβερνητικοί αξιωματούχοι θα πρέπει να τονίσουν όχι μόνο την αξία της τεχνητής νοημοσύνης αλλά και την σημασία της διασφάλισης της αξιοπιστίας και της ασφάλειας.

Τέλος, οι Ηνωμένες Πολιτείες θα πρέπει να αναζητήσουν τρόπους συνεργασίας με άλλες χώρες, ακόμη και εχθρικές, για να εξασφαλίσουν την ασφάλεια της AI. Η διεθνής συνεργασία για τις νέες τεχνολογίες έχει ένα μικτό ιστορικό, αλλά ορισμένες φορές οι χώρες κατάφεραν να συνεργαστούν για να αποφευχθεί μια αμοιβαία ζημία. Κατά την διάρκεια του Ψυχρού Πολέμου, οι Ηνωμένες Πολιτείες και η Σοβιετική Ένωση συνεργάστηκαν για να περιορίσουν ορισμένους τύπους συστημάτων μεταφοράς πυρηνικών κεφαλών, για τις οποίες και οι δύο πλευρές συμφώνησαν ότι ήταν ιδιαίτερα αποσταθεροποιητικές. Οι Ηνωμένες Πολιτείες ενθάρρυναν επίσης άλλες χώρες να υιοθετήσουν μέτρα ασφαλείας για την πρόληψη της μη εξουσιοδοτημένης χρήσης πυρηνικών όπλων. Σήμερα, οι Ηνωμένες Πολιτείες θα πρέπει να συνεργαστούν με τους συμμάχους και τους αντιπάλους τους για να ενισχύσουν την διεθνή χρηματοδότηση για την ασφάλεια της AI. Θα πρέπει επίσης να αρχίσουν συζητήσεις με την Κίνα και την Ρωσία σχετικά με το κατά πόσον ορισμένες εφαρμογές της AI δημιουργούν απαράδεκτους κινδύνους κλιμάκωσης ή απώλειας ελέγχου, και τι μπορούν οι χώρες να κάνουν από κοινού για την βελτίωση της ασφάλειας. Ο μεγαλύτερος κίνδυνος για τις Ηνωμένες Πολιτείες σε μια κούρσα AI δεν να χάσουν, αλλά να δημιουργηθεί ένας κόσμος στον οποίο κανείς δεν κερδίζει.

Κατά τον 19ο αιώνα, η εκβιομηχάνιση έφερε τεράστια οικονομική ανάπτυξη, αλλά έδωσε επίσης στους στρατούς το τανκ, το πολυβόλο και το αέριο της μουστάρδας. Η εφεύρεση των πυρηνικών όπλων έθεσε έναν ακόμη πιο βαθύ κίνδυνο, έναν [κίνδυνο] με τον οποίο οι υπεύθυνοι για την χάραξη πολιτικής εξακολουθούν να παλεύουν. Οι υπολογιστές επαναστατικοποίησαν τον τρόπο με τον οποίο οι άνθρωποι δουλεύουν, μαθαίνουν και επικοινωνούν, αλλά επίσης έκαναν τα προηγουμένως απομονωμένα συστήματα να είναι ευάλωτα σε κυβερνοεπιθέσεις.

Η AI θα ταιριάξει με αυτές τις αλλαγές. Τα περισσότερα από τα αποτελέσματά της θα είναι θετικά. Θα ενισχύσει την οικονομική ανάπτυξη, θα βοηθήσει στην διάγνωση και θεραπεία ασθενειών, θα μειώσει τα τροχαία ατυχήματα και θα βελτιώσει την καθημερινή ζωή των ανθρώπων με χιλιάδες τρόπους, τόσο μεγάλους όσο και μικρούς. Όπως και κάθε νέα τεχνολογία, ωστόσο, η AI έχει επίσης μια σκοτεινότερη πλευρά. Το να αντιμετωπιστούν οι κίνδυνοι τώρα, είναι ο μόνος τρόπος για να γίνει βέβαιο ότι η ανθρωπότητα υλοποιεί την υπόσχεση της AI, κι όχι τους κινδύνους.

Copyright © 2019 by the Council on Foreign Relations, Inc.

All rights reserved.

Στα αγγλικά: https://www.foreignaffairs.com/articles/2019-04-16/killer-apps

* Το δοκίμιο αυτό έχει δημοσιευθεί στο τεύχος αριθ. 62 (Φεβρουάριος - Μάρτιος 2020) του Foreign Affairs The Hellenic Edition.

Σύνδεσμοι:

[1] https://www.amazon.com/Army-None-Autonomous-Weapons-Future/dp/0393608980

[2] https://www.theverge.com/2017/9/4/16251226/russia-ai-putin-rule-the-world

[3] https://qz.com/1034972/the-data-that-changed-the-direction-of-ai-researc...

[4] https://medium.com/waymo/where-the-next-10-million-miles-will-take-us-de...

[5] https://www.ft.com/content/ea707a24-f6b7-11e7-8715-e94187b3017e

[6] https://deepmind.com/blog/alphazero-shedding-new-light-grand-games-chess...

[7] https://www.mckinsey.com/~/media/mckinsey/featured%20insights/Digital%20...

[8] https://blog.openai.com/ai-and-compute/

[9] https://www.hrw.org/report/2018/09/09/eradicating-ideological-viruses/ch...

[10] https://www.wsj.com/articles/china-said-to-deploy-big-data-for-predictiv...

[11] https://www.wsj.com/articles/the-all-seeing-surveillance-state-feared-in...

[12] https://www.wsj.com/articles/twelve-days-in-xinjiang-how-chinas-surveill...

[13] https://chinadigitaltimes.net/2018/10/company-touts-ai-powered-facial-re...

[14] https://www.nanalyze.com/2018/06/10-biggest-artificial-intelligence-star...

[15] https://arxiv.org/pdf/1803.03453.pdf

[16] http://www.argmin.net/2017/12/11/alchemy-addendum/

[17] https://arxiv.org/pdf/1412.6572.pdf

[18] https://arxiv.org/pdf/1707.08945.pdf

Μπορείτε να ακολουθείτε το «Foreign Affairs, The Hellenic Edition» στο TWITTER στην διεύθυνση www.twitter.com/foreigngr αλλά και στο FACEBOOK, στην διεύθυνση www.facebook.com/ForeignAffairs.gr και στο linkedin στην διεύθυνση https://www.linkedin.com/company/foreign-affairs-the-hellenic-edition